Google und Ebay Bewertungen steuern Warenflüsse, mehr noch als jede Werbung.

Sie aggregieren verteiltes Wissen, komprimieren es zu Signalen und machen es für Dritte nutzbar – immer unter der Voraussetzung, dass die Eingabedaten die Realität hinreichend abbilden. Diese Voraussetzung ist keine technische Selbstverständlichkeit, sondern eine normative Anforderung, die im Alltag digitaler Plattformen aber immer mehr ignoriert wird.

Nehmen wir eBay. Seit November 2025 hinterlegt die Plattform automatisch eine positive Bewertung, wenn ein Käufer nach abgeschlossenem Kauf sich nicht meldet. Die Begründung ist nachvollziehbar: Schweigen ist häufig tatsächlich Zufriedenheit, und ein dichtes Bewertungsnetz stabilisiert das Vertrauen in den Marktplatz. Aber das System misst nicht mehr damit, was es zu messen vorgibt. Eine positive Bewertung, die nicht auf erlebter Zufriedenheit beruht, sondern auf dem Ausbleiben einer Handlung, ist wie ein Datum ohne Zeitangabe – formal vorhanden, semantisch leer. Wer einen defekten Artikel erhält und es versäumt, fristgerecht zu reagieren, erscheint im System als zufriedener Käufer. Das Protokoll stimmt. Aber mit der Realität hat das nichts mehr zu tun.

Google operiert nach derselben Logik, nur mit umgekehrtem Vorzeichen. Negative Bewertungen, die nachweislich auf realen Erfahrungen beruhen – und deren Authentizität Nutzer sogar per eidesstattlicher Erklärung belegt haben – werden auf Antrag des bewerteten Unternehmens routinemäßig gelöscht, wenn das Unternehmen “Unangemessenheit” oder “Diffamierung” geltend macht. Das Ergebnis ist dasselbe wie bei eBay, nur eine Eskalationsstufe darüber: Nicht Schweigen wird als Zustimmung kodiert, sondern das Missfallen wird zum Verschwinden gebracht. Was bleibt, ist kein Abbild der Realität mehr, sondern ein gefiltertes, plattformkonformes Surrogat, das dem widersprechenden Unternehmen höhere Einnahmen beschert.

Man könnte von struktureller Deception sprechen – einer Täuschung, die nicht aus Absicht, sondern aus Design entsteht1. Das Beunruhigende daran ist gerade die Absichtslosigkeit: Weil kein einzelner Akteur mehr verantwortlich zeichnet, fehlt auch die Motivation zur Korrektur. Bei einer klassischen Lüge gibt es einen Täuschenden, der zur Rechenschaft gezogen werden kann. Bei einem absichtlich auf Täuschung konstruierten Bewertungsalgorithmus gibt es nur ein Produktteam, das auf Conversion-Raten schaut. Ethik oder Moral? Brauchen wir nicht, unvergesslich das Video vom großen Tech-CEO-Vasallen-Dinner im September 2025 auf dem betonierten Rasen vor dem Weißen Haus.

Schlimmer noch: automatisierte Systeme skalieren diesen Effekt hoch. Was im Einzelfall als Ungenauigkeit wirkt, akkumuliert sich über alle AI’s zu einem systematischen Vertrauensproblem. Vertrauenssysteme, die sich selbst korrumpieren, verlieren damit aber jeden Tag mehr an Nützlichkeit – sie kippen um. Die Sterne leuchten noch, aber bedeuten nichts mehr. Das betrifft auch jede positive Bewertung, die nun als Werbung degradiert wird, aber eigentlich auf einer Erfahrung beruhte, sofern sie nicht auch gekauft war.

Ist das organisierter Betrug?

Juristisch kaum. Bandenmäßiger Betrug setzt nach § 263 StGB Täuschungsabsicht, Irrtumserregung und Vermögensschaden voraus – und bei der Qualifikation “bandenförmig” eine organisierte Mehrtäterstruktur mit Tatplan. Beide Unternehmen handeln aber offen: Das Schweigen-gleich-Zustimmung-Prinzip und Jederzeit-Löschen-Prinzip steht mit Sicherheit irgendwo in den Nutzungsbedingungen. Juristisch greifbar wäre allenfalls irreführende Geschäftspraxis im Sinne des UWG oder der europäischen Omnibus-Richtlinie.

Epistemisch aber – im Kern ist es natürlich Betrug. Wenn man Betrug funktional versteht, als systematische Erzeugung falscher Überzeugungen zum eigenen Vorteil, dann trifft die Beschreibung erstaunlich gut: eBay profitiert von stabilen Verkäuferbewertungen, Google von einem bereinigten Reputationssystem, das Unternehmenskunden nicht vergraullt. Dass dies ohne strafrechtlich relevante Absicht geschieht, macht es gesellschaftlich nicht weniger problematisch – es macht es nur schwerer angreifbar.

Die Omnibus-Richtlinie – EU-Richtlinie 2019/2161, in Deutschland seit Mai 2022 in Kraft, hat das UWG geändert. Der für unseren Kontext entscheidende Punkt: Plattformen sind seither verpflichtet offenzulegen, ob und wie sie Bewertungen auf Echtheit prüfen. Wer suggeriert, Bewertungen seien authentisch, ohne ein Prüfverfahren zu betreiben, handelt nun unlauter. Außerdem sind gekaufte oder anderweitig gefälschte Bewertungen ausdrücklich als unlautere Geschäftspraxis eingestuft. Warum greift das bei eBay und Google trotzdem nicht? Weil beide Unternehmen formal prüfen – nur eben nicht auf Wahrheit, sondern auf Regelkonformität. eBay prüft, ob eine Transaktion stattgefunden hat. Google prüft, ob eine Beschwerde vorliegt. Das genügt juristisch als “Prüfverfahren”, auch wenn das Ergebnis völlig wertlos ist. Die Richtlinie hat eine Lücke dort, wo es darauf ankäme: Sie reguliert das Verfahren, nicht die Qualität des Ergebnisses.

Die folgenden drei Fallbeispiele im Anhang illustrieren, wie Konstruktionsbias und strukturelle Täuschung in unterschiedlichen Kontexten auftreten, wobei sich der Leser gerne selbst die Konsequenzen ableiten kann..

Anhang Fallbeispiel

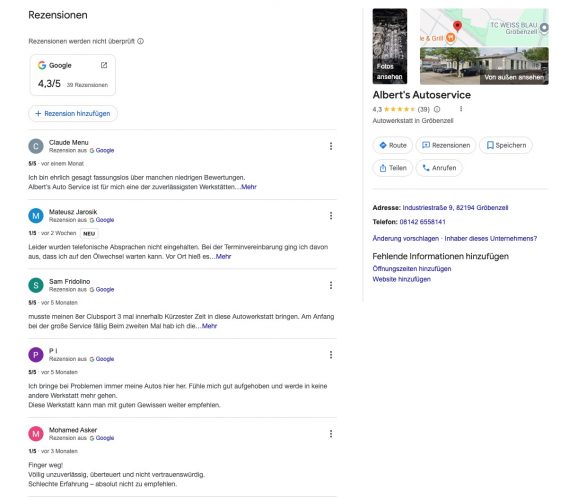

Albert’s Auto Service Gröbenzell

Im September 2024 beauftragte ein Kunde die Werkstatt von Burim Qeriqi in Gröbenzell mit der Reparatur eines Kurzschlusses. Die Rechnung belief sich auf 255,17 Euro. Die anschließend aufgesuchte Fachwerkstatt stellte schriftlich in ihrer Rechnung fest, dass die Lampen in beiden Fassungen fehlten oder falsch angeschlossen waren, die Verkabelung der dritten Bremslampe nicht funktionierte und korrodierte Kabelverbindungen am Unterboden unangetastet geblieben waren. Die Nachbesserung kostete 720,00 Euro. Qeriqi ist, wie sich später herausstellte, kein Mitglied der KFZ-Innung – ein Umstand, der auf seiner Google-Seite naturgemäß nicht vermerkt ist. Die sachliche und belegbare Rezension des Kunden auf Google verschwand jedenfalls bald darauf. Ein Tracing der Bewertungen über achtzehn Monate ergab: Die Werkstatt löscht negative Bewertungen systematisch und umgehend. Google stellt dafür das Werkzeug bereit – ohne Prüfung der inhaltlichen Berechtigung, ohne Berücksichtigung von Belegen. Eine einzelne negative Bewertung, die zum Zeitpunkt der Recherche noch sichtbar war, illustriert eher die Geschwindigkeit des Löschvorgangs als dessen Ausnahmen. Was auf der Profilseite verbleibt, ist kein Abbild der Kundenerfahrungen, sondern das Ergebnis aktiven Reputationsmanagements – ermöglicht und abgesichert durch die Plattform.

Fallbeispiel 2

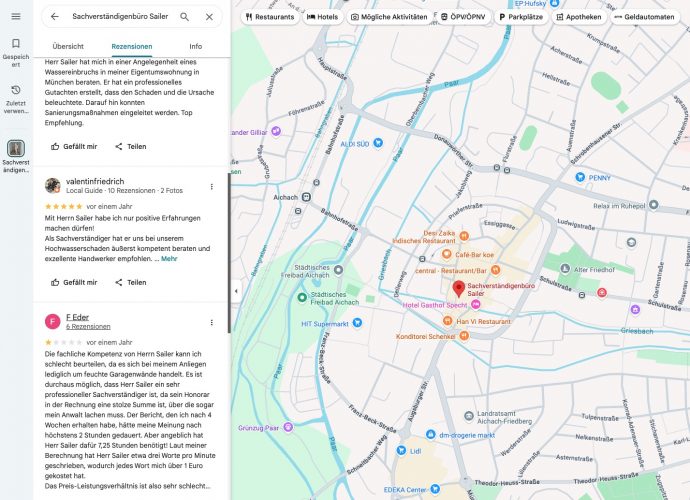

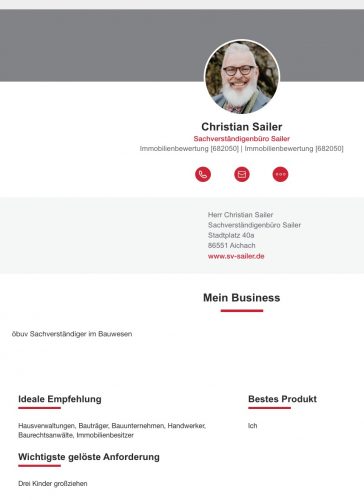

Gutachter Büro Christian Sailer Aichach.

Der Gutachter wird wegen eines Wasserschadens von einem Kunden auf Rat seines Anwalts kontaktiert. Der Gutachter erscheint spät, unvorbereitet, liefert statt einer strukturierten Bestandsaufnahme einen langatmigen Vortrag. Der Kunde bricht das Gutachten ab. Die anschließende Honorarforderung landet vor Gericht und endet mit einem Vergleich – einem rechtsförmigen Abschluss, der den Sachverhalt aktenkundig macht. Der Kunde verfasst daraufhin eine präzise, tatsachenbasierte Rezension auf Google: keine Polemik, keine Vermutungen, nur der dokumentierte Hergang mit der Empfehlung keinen Blanko Werkauftrag zu unterschreiben. Das Ergebnis ist vorhersehbar. Google teilt mit, eine Beschwerde wegen Diffamierung erhalten zu haben, und löscht den Zugriff auf den Beitrag 2. Die Begründung lautet lapidar: der Inhalt “verstößt anscheinend gegen” die entsprechende Kategorie. Kein Nachweis, keine Abwägung, kein Einblick in die Prüfung, keine Reaktion auch auf die Reklamation, die Bewertung stehen zu lassen. Das Wort “anscheinend” ist dabei bezeichnend – es signalisiert, dass keine eigentliche Prüfung stattgefunden hat, sondern eine Kategorisierung. Was hier verschwindet, ist keine Meinung, sondern ein gerichtlich bestätigter Sachverhalt. Die Plattform fungiert als Zensurinstanz ohne Erkenntnisinteresse: Sie prüft nicht, ob eine Aussage wahr ist, sondern ob jemand Einspruch erhoben hat..

Fallbeispiel 3

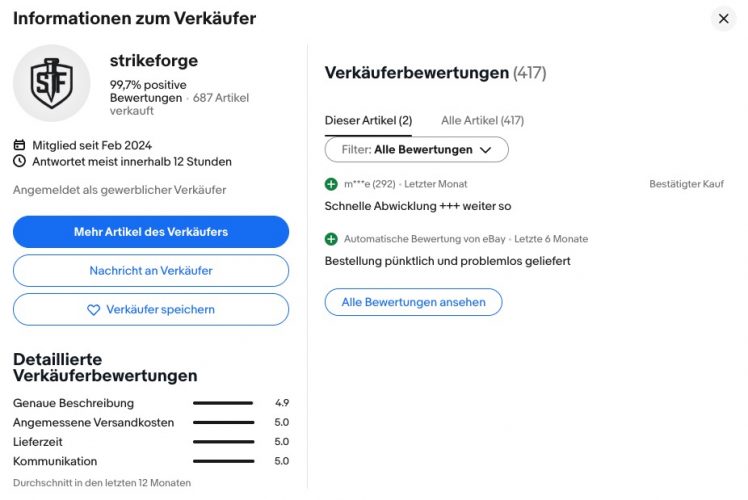

Strikeforge GbR Ebay Händler

Ein Kunde kauft auf eBay einen AirTag-Halter aus dem 3D-Drucker – billiges Filament, zu geringe Wandstärke. Das Teil bricht kurz darauf unterwegs ab, der AirTag geht verloren – 5,99 € für den Halter, 32,99€ Verlust für den AirTag summieren sich zu 39€. Ohne Garantie, ohne Schadenersatz, dafür aber mit Belehrung durch den Verkäufer Philipp Huguenin, daß die Widerrufsfrist “bereits seit längerer Zeit abgelaufen ist. Schäden, die nach dieser Nutzungsdauer durch Belastung im Gebrauch entstehen, können wir leider nicht als Reklamation übernehmen. Vielen Dank für dein Verständnis.” Der Verkäufer dreht die Beweislast auch noch um – er definiert den Produktfehler (zu geringe Wandstärke) als Gebrauchsverschleiß und entzieht sich damit jeder Gewährleistungspflicht. Die gesetzliche Gewährleistungsfrist beträgt 2 Jahre ab Kauf – die Widerrufsfrist (14 Tage) ist etwas völlig anderes. Die Verwechslung von Widerrufsrecht und gesetzlicher Gewährleistung zeigt entweder Unkenntnis oder Kalkül. Der Kunde gab jedenfalls keine Bewertung ab. Nach dem Kauf erscheint auf eBay aber eine positive Bewertung für den Kauf – automatisch generiert, plattformkonform, sachlich falsch.

Das ist der Mechanismus in Reinform. Kein Verkäufer hat gelogen. Kein Algorithmus hat eine Entscheidung getroffen, die sich jemand bewusst überlegt hätte. Das System hat schlicht Schweigen als Zufriedenheit interpretiert und daraus eine Aussage gemacht. Der Verkäufer der mangelhaftenWare sammelt weiter positive Bewertungen. Der nächste Käufer verlässt sich darauf. Der AirTag des Übernächsten geht ebenfalls verloren – informiert durch ein Bewertungssystem, das funktioniert, solange man nicht fragt, was es eigentlich misst.

Literatur

1 Der Begriff schließt an Miranda Frickers Konzept der hermeneutical injustice an: Strukturelle Lücken im kollektiven Deutungsrepertoire führen dazu, dass bestimmte Erfahrungen nicht adäquat artikuliert – oder in diesem Fall: nicht dauerhaft dokumentiert – werden können. Fricker, M.: Epistemic Injustice. Power and the Ethics of Knowing. Oxford 2007

2 siehe auch SWR vom 7.7.2025 “Google-Bewertungen: Warum ehrliche Kritik oft gelöscht wird”

Googles Antwort: Allgemein und ausweichend

In einem offiziellen Erklärvideo beschreibt Google, wie Rezensionen geprüft werden: mithilfe von künstlicher Intelligenz und einem Moderationsteam. 2024 seien über 240 Millionen Beiträge entfernt worden.

„Unsere Richtlinien besagen eindeutig, dass Rezensionen auf echten Erfahrungen beruhen müssen – weshalb wir umgehend gegen böswillige Akteure vorgehen (…)“, schreibt Google.Sackgasse für ehrliche Meinung

Kunden, deren ehrliche Meinung immer wieder gelöscht wird, sind frustriert. Was sie erleben, nimmt ihnen das Vertrauen in das Bewertungs-System.