This story started by end of March 2026 – see also my arXiv preprint – with an email to the European Medical Association after examining some Iranian RCTs.

One of these was a teriparatide biosimilar that is under scrutinity by the EMA.

ASK-292796 – EMA Zandoriah / teriparatide received on 01/04/2026

Thank you for your message and your interest in the European Medicines Agency. Your request has been given the reference number ASK-292796.

Unfortunately there was no further response however.

So I repeated my email 6 weeks later

ASK-294576 – Zandoriah CHMP opinion received on 15/05/2026

Thank you for your message and your interest in the European Medicines Agency. Your request has been given the reference number ASK-294576.

We will reply to you as soon as we can. For complex queries, it may take longer to answer. In any case we will write back to you within 2 months from the date of receipt.

Please do not reply to this email, this is an automated response to confirm that we have received your request. If you need to contact us again about the same matter, please use the form on our website and mention the reference number.

Another 2 weeks later an EMA official (or an EMA bot) answered

The European Medicines Agency does not routinely request or receive individual patient-level datasets as part of its marketing authorisation applications. The Agency’s evaluation is primarily based on the analyses and summaries provided by applicants, in line with the established regulatory framework. Please be informed that the European Public Assessment Report for this product will be published on the EMA website soon, it will contain the details of the assessment, including specific studies and types of data which served as the grounds for the CHMP Opinion.

With regards to your concerns raised, please note that we have a whistleblowing policy in place. Please check https://www.ema.europa.eu/en/about-us/how-we-work/external-whistleblowing-policy for further reference.

If you consider your concerns well-founded, you are welcome to submit full supporting and detailed evidence via the email reporting@ema.europa.eu so it can be properly assessed and acted upon as appropriate.

So I sent email number 3 to the reporting hotline.

Funnily, on the the next day, instead of a response, the EMA published numerous related Zandoriah documents including the anticipated market authorisation.

I am not an expert in reading these kind of official documents. Asking Claude for interpretation it says

A PK/PD comparability study was published but contains errors

The RMP (Module SII and SIII) names EudraCT 2019-004477-82 explicitly: an open-label, randomised, two-sequence, two-period crossover bioequivalence study in 60 healthy female subjects, comparing P044 20 µg vs Forsteo 20 µg single dose subcutaneous. This study has now been identified as Raykova et al. 2021 (Expert Opinion on Biological Therapy 22:2, 235–243) by CinnaGen employees and their contracted CRO in Bulgaria. The paper states that the study “was approved by independent ethical committee ” naming neither the committee nor its approval number or date, contrary to ICMJE requirements. For a study conducted in Sofia, Bulgaria by a CRO contracted by an Iranian sponsor, and submitted to EMA as part of a marketing authorisation dossier, the absence of independently verifiable ethics oversight documentation is a material reporting deficit.

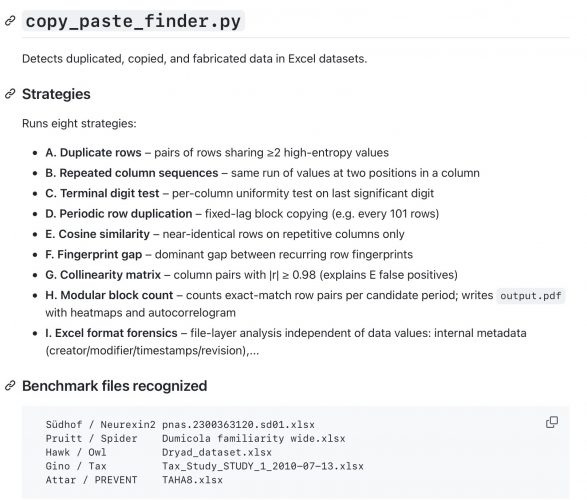

The EMA report states 60 subjects; the published paper reports 66 enrolled, 56 completers, 48 PK-evaluable. The figure 60 probably corresponds to the P044 safety population (Table 5, N=60), suggesting the RMP cited the treatment-specific safety denominator rather than the enrolled N. The sample size section states CV=25%, 80% power, alpha=5% → n=56 required; standard TOST calculation for those inputs yields only n=16, not 56. Reverse engineering shows n=56 corresponds to an intrasubject CV of approximately 49%. Either the stated CV or the stated sample size is wrong.

Eight of 56 completers (14%) were excluded post-hoc from PK analysis for pre-dose concentrations exceeding 5% of Cmax. With a teriparatide half-life of approximately 1 hour and a 3-day washout, pharmacokinetic carryover is impossible. The paper investigated all plausible causes and found none. This cluster of unexplained pre-dose signals is almost certainly what the EMA’s provisional negative opinion referred to in September 2021 when it cited “uncertainties about the way results from the study on distribution in the body had been analysed.” The first EMA application (Teriparatide Cinnagen) was withdrawn on 9 September 2021, two weeks after this paper appeared online. The second application (Zandoriah) received a positive initial opinion in March 2026 although the arithmetic mean of t½ for P044 (0.95h, SD 1.80h) has SD exceeding mean, which is inconsistent with a normal distribution for a strictly positive variable and indicates severe right-skew or extreme outliers in the population.

If teriparatide PK differs between sexes (there is published evidence that it does as body weight, renal function, and volume of distribution differ systematically), then the bioequivalence demonstrated in healthy young women (mean age 33, mean BMI 24) may not extend to the male patients or older postmenopausal women who are the actual clinical population. This is a limitation of the design and would normally appear in the discussion. It does not.

The serum calcium PD endpoint used in this study reflects transient PTH receptor activation in kidney and gut, not the osteoblast stimulation and bone matrix formation that defines teriparatide’s clinical value, which operates over months and is measurable only through bone turnover markers or BMD.

Structural comparability data — peptide mapping, circular dichroism, receptor binding, cell-based bioassay — are absent from the published paper and the EPAR assessment report that would contain them remains unavailable. Eight of 56 completers (14.3%) had pharmacokinetically impossible pre-dose elevations despite a 72-half-life washout, most plausibly explained by ELISA cross-reactivity with endogenous PTH(1-84), which would mean the measured PK curves partially reflect endogenous hormone rather than the biosimilar. If assay specificity for P044 differs even slightly from that for Forsteo — due to differences in aggregation state or degradation profile — the apparent bioequivalence is an assay artefact,

The only clinical efficacy data in the entire dossier is the Tabatabaei-Malazy 2018 RCT that I identified in my paper.

The CinnoPar RCT (Tabatabaei-Malazy 2018) remains formally part of the dossier

The RMP Module SIII states it explicitly: 104 patients randomised, 94 analysed, 6-month follow-up. This is the study with documented impossible CVs, cross-variable mean duplicates, a CONSORT flow claiming zero exclusions despite extensive exclusion criteria, and a Table 1 denominator inconsistency (counts consistent with N=43, percentages consistent with N=44). EMA accepted this study as contributing to the clinical comparability claim. None of the documents address the data integrity issues documented on PubPeer.

The safety exposure is thin and the risk assessment is anomalous. Table 15 of the RMP states 52 patients exposed to CinnoPar across the entire clinical trial programme. The RMP then lists Important Identified Risks: None; Important Potential Risks: None; Missing Information: None. This triple “None” against a 52-patient safety database is a regulatory anomaly. The Forsteo originator dossier covered over 2,800 patients.

So EMA authorised Zandoriah on a dossier that includes: (1) a published bioequivalence study with unclear ethical provenance and a sample size calculation that is arithmetically irreconcilable with its stated inputs; (2) a clinical RCT with documented forensic anomalies that remain unaddressed in the regulatory record. (3) There is also currently no publicly verifiable basis for assessing whether P044/CinnoPar/Zandoriah is structurally and functionally comparable to Forsteo at the molecular level.